Kategorie: KI-Modelle

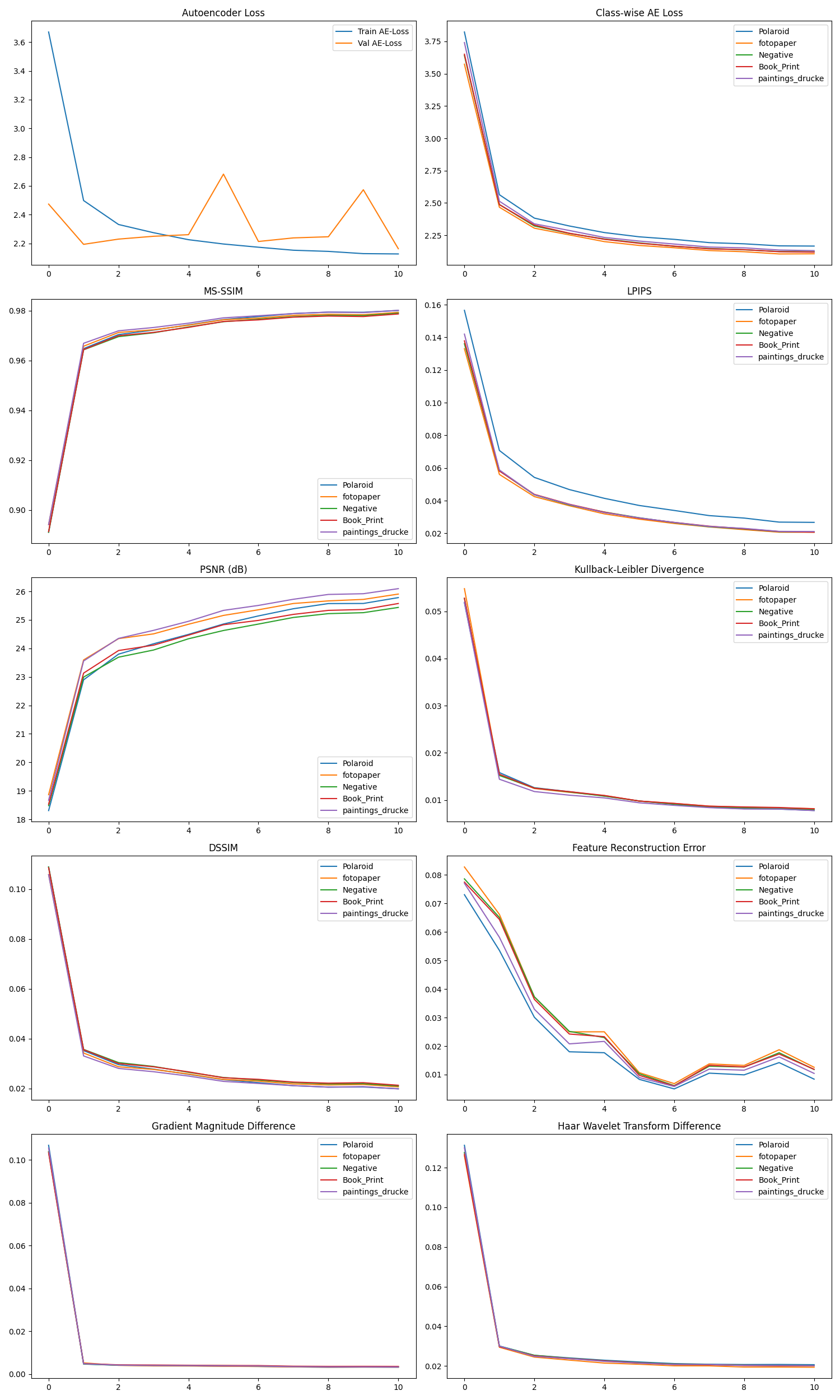

Einleitung: Die Genesis einer präzisionsgetriebenen Scan-Revolution In der dynamischen und stets sich transformierenden Sphäre der digitalen Bildverarbeitung etabliert sich das Projekt Bild/Papier-Scanner als ein bahnbrechendes Monument wissenschaftlicher Ingeniosität, das die Grenzen der Unstimmigkeitserkennung und -korrektur in gescannten Medien neu definiert. Dieses ambitionierte Vorhaben integriert hochentwickelte Machine-Learning-Paradigmen, insbesondere eine intricately gestaltete Autoencoder-Architektur, um die vielschichtigen, multidimensionalen…

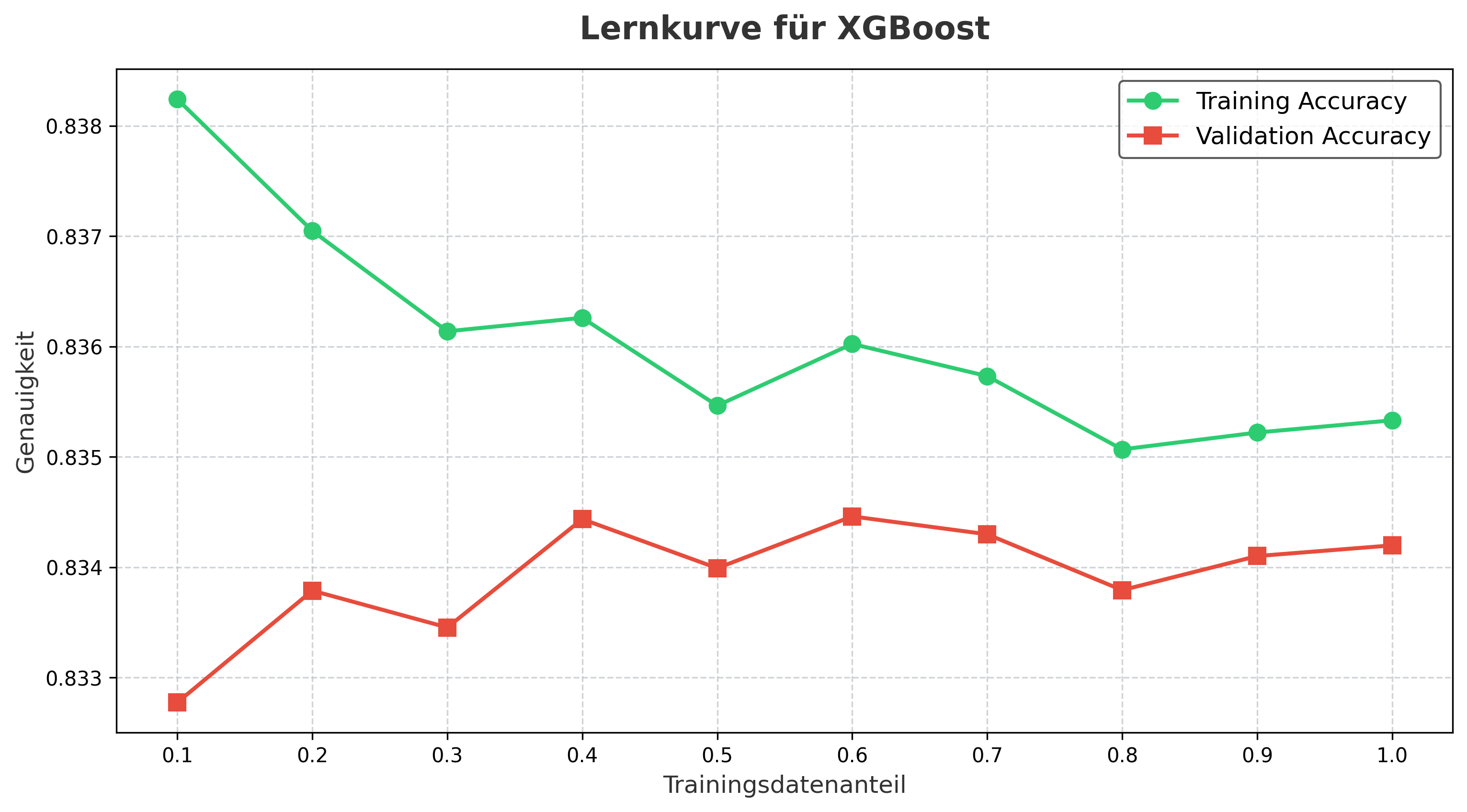

In einer digitalen Welt, in der die Manipulation von Video- und Bildinhalten durch Deepfake-Technologien stetig an Raffinesse gewinnt, gewinnt die Sicherung der Echtheit visueller Medien an Bedeutung. Deepfakes, künstlich generierte Inhalte, die täuschend echt wirken, können das Vertrauen in Medien untergraben und erhebliche ethische sowie gesellschaftliche Herausforderungen mit sich bringen. Dieses Modell, entwickelt auf Basis…

In einer digitalen Ära, in der die Manipulation von Video- und Bildinhalten durch Deepfake-Technologien stetig an Komplexität gewinnt, wird die Sicherung der Echtheit visueller Medien zu einer zentralen Herausforderung. Deepfakes, künstlich generierte Inhalte, die täuschend echt wirken, können das Vertrauen in Medien untergraben und erhebliche ethische sowie gesellschaftliche Fragen aufwerfen. Dieses Modell, entwickelt auf Basis…

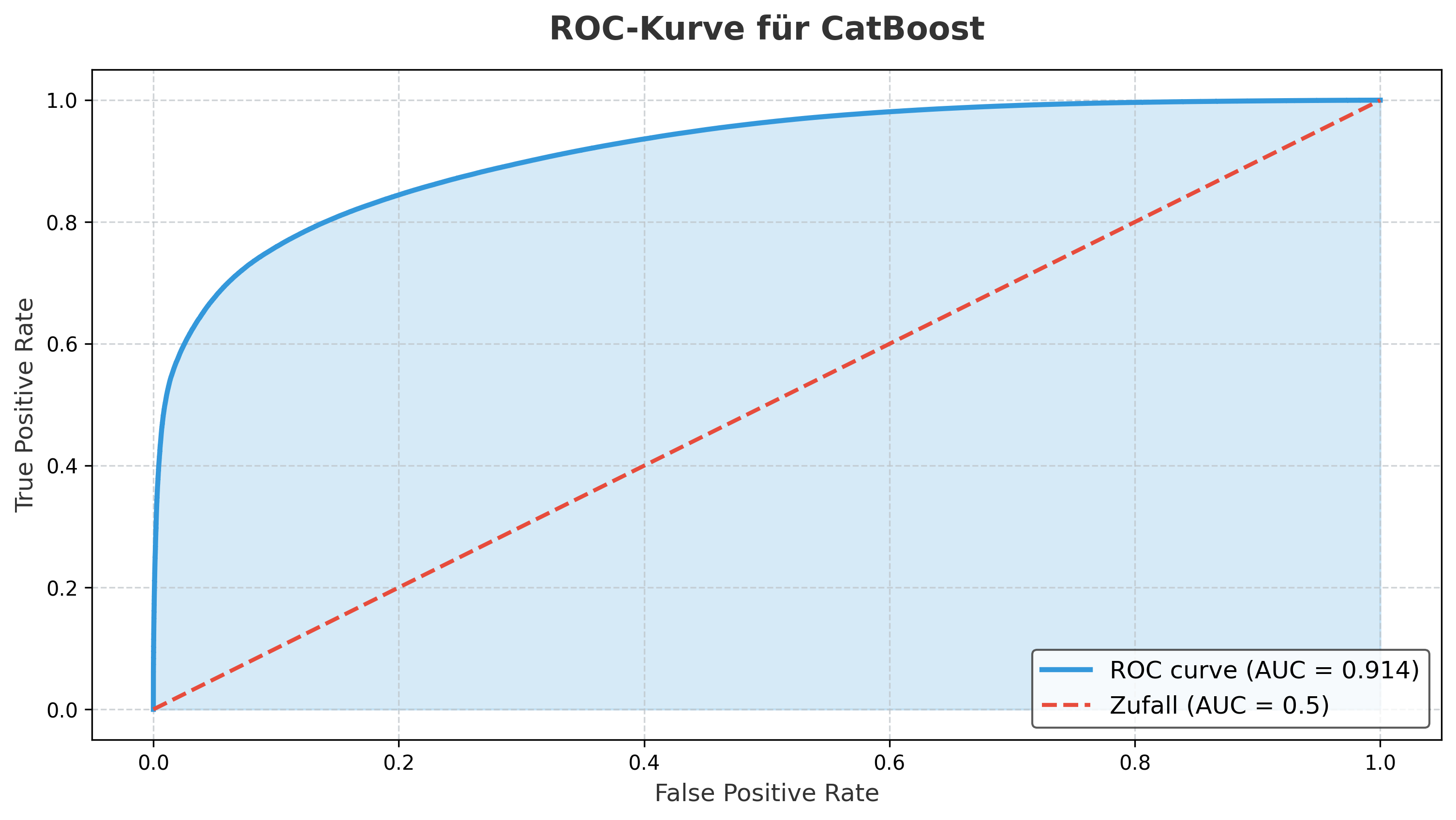

In einer digitalen Welt, in der die Manipulation von Video- und Bildinhalten durch Deepfake-Technologien immer ausgefeilter wird, steht die Sicherung der Echtheit visueller Medien vor neuen Herausforderungen. Deepfakes, künstlich generierte Inhalte, die täuschend echt wirken, können das Vertrauen in Medien untergraben und erhebliche ethische sowie gesellschaftliche Fragen aufwerfen. Dieses Modell, entwickelt auf Basis des CatBoost-Algorithmus,…

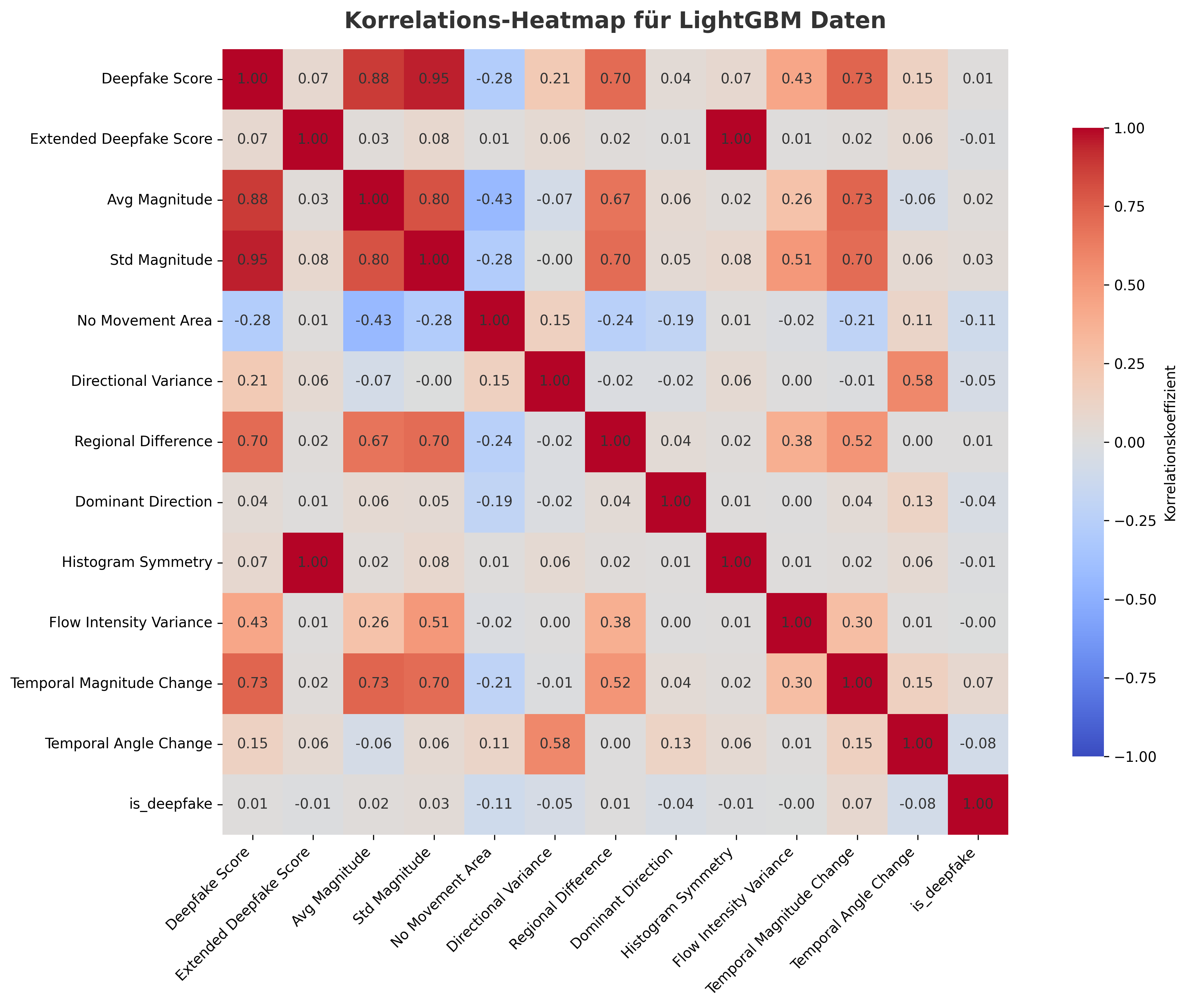

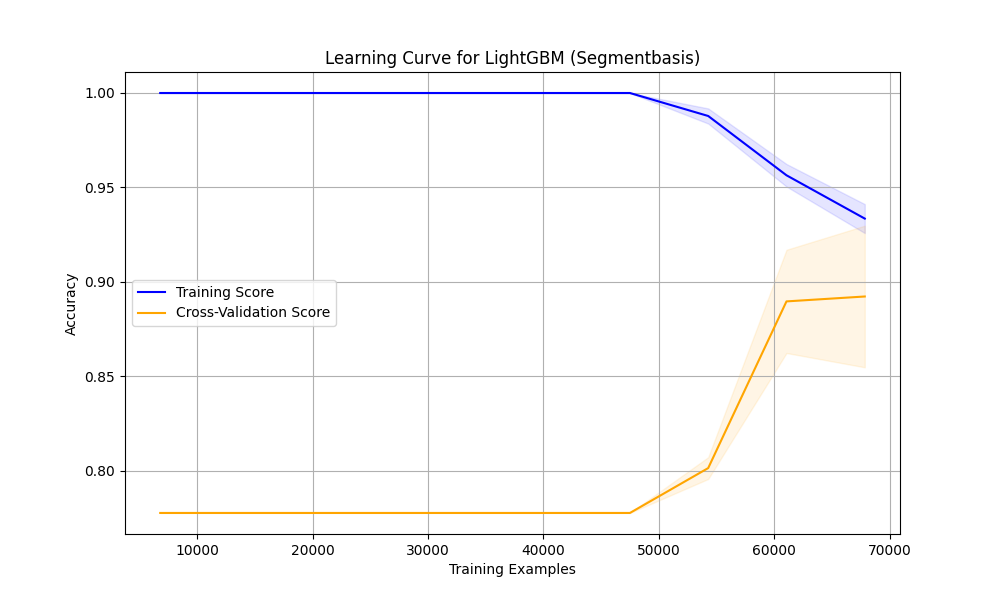

Einführung Die zunehmende Verbreitung von Deepfakes – künstlich generierten oder manipulierten Medien, insbesondere im Audio-Bereich – stellt eine Herausforderung für die digitale Sicherheit dar. Gefälschte Stimmen können in Nachrichten, rechtlichen Kontexten oder persönlichen Kommunikationen schwerwiegende Folgen haben. Hinter der Erkennung solcher Manipulationen steht oft fortschrittliche KI-Technologie, wobei das LightGBM-Modell (Light Gradient Boosting Machine) eine zentrale…