Deepfakes werden täglich besser. Die Gesichter sind perfekt, die Mimik stimmt, die Stimme klingt echt. Wer nur hinsieht, wird getäuscht.

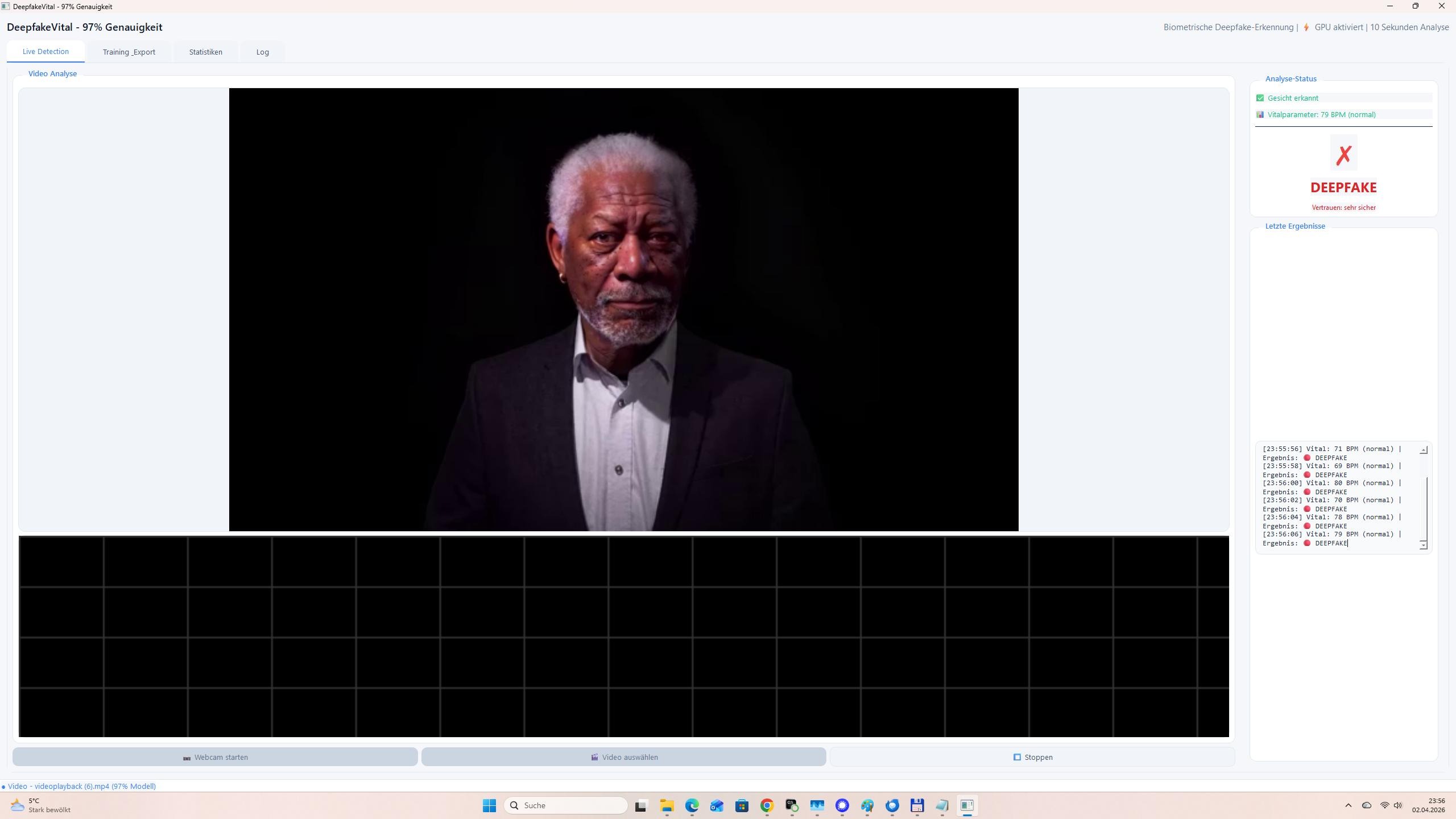

Die jüngste Entwicklung ist alarmierend: Hochwertige Deepfake-Videos können mittlerweile einen realistischen Herzschlag imitieren – was bisher als sicheres Erkennungsmerkmal galt, fällt damit aus. Die Forscher am Fraunhofer Heinrich-Hertz-Institut (HHI) zeigten, dass moderne Deepfakes die physiologischen Signaturen der Originalpersonen „erben“ können.

Doch es gibt eine Sache, die keine KI der Welt fälschen kann: Leben.

Ein echter Mensch sendet permanent unsichtbare Vitalzeichen aus. Winzige Farbveränderungen der Haut durch den Blutfluss. Mikrofeine rhythmische Muster. Ein organisches Zusammenspiel von Herz, Kreislauf und Atmung.

Ein Deepfake hat das nicht – zumindest nicht in der räumlichen und zeitlichen Komplexität eines echten Menschen. Ein Deepfake ist Pixel. Statistik. Interpolation. Aber kein lebendiges, atmendes System.

Die gesamte Erkennungstechnologie baut auf dieser einen simplen Beobachtung auf:

Wenn es lebt, sendet es Vitalzeichen aus. Wenn es nicht lebt, fehlen diese Zeichen – oder sie sind räumlich inkonsistent.

So einfach ist die Kernidee.

Weiterführend:

- Fraunhofer HHI Studie zu Deepfakes mit Herzschlag

- Research in Germany – englische Zusammenfassung

- Biometric Update – Branchenperspektive

Personengebunden: Der gefährlichste Deepfake-Typ

Nicht alle Deepfakes sind gleich. Die größte Bedrohung für Unternehmen, Behörden und Privatpersonen sind personengebundene Deepfakes – also Fälschungen, die eine bestimmte, identifizierbare Person zeigen.

Ein CEO, der angeblich vertrauliche Daten preisgibt. Eine Politikerin, die etwas sagt, das sie nie gesagt hat. Ein Prominenter, der in einer Situation gezeigt wird, in der er nie war.

Diese Art von Deepfake ist besonders tückisch, weil sie Vertrauen missbraucht. Der Zuschauer denkt, er kennt die Person. Die Stimme klingt vertraut. Das Gesicht ist unverkennbar.

Die Bedrohung ist real und wächst. Das Bundesamt für Sicherheit in der Informationstechnik (BSI) warnt eindringlich vor Deepfake-basiertem Betrug – etwa wenn gefälschte Videos von Prominenten für Kryptowährungs-Scams genutzt werden. Die Behörde stellt fest: Die Bevölkerung überschätzt massiv ihre Fähigkeit, KI-generierte Inhalte zu erkennen.

Genau hier setzt die Vitalzeichen-Methode an. Sie prüft nicht, ob das Gesicht einer bestimmten Person ähnelt. Sie prüft, ob in diesem Gesicht räumlich und zeitlich konsistente Vitalmuster stecken. Egal, wen es darstellt.

Das macht das System immun gegen den gefährlichsten Angriffsvektor: die gezielte Fälschung einer konkreten Person.

Hintergrund:

- BSI – Cybersicherheitsmonitor 2026 (heise online)

- BSI – Deepfakes und ihre Gefahren (deutsch)

- Europol – Facing Reality of Deepfakes

600 Stunden Trainingsmaterial: Die größte Datenbasis ihrer Art

Um diese Idee zu testen, wurde etwas Beispielloses getan: 600 Stunden Videomaterial wurden als Trainingsgrundlage für die KI zusammengetragen – aufgeteilt in genau zwei Hälften.

300 Stunden echte Aufnahmen von lebenden Menschen:

- Gesprächssituationen mit verschiedenen Sprecherinnen und Sprechern

- unterschiedliche Altersgruppen, Hauttypen und Lichtverhältnisse

- natürliche Bewegungen, Pausen, Atemrhythmen

300 Stunden Deepfake-Videos:

- aufgebaut aus zehntausenden Einzelclips

- jede Fälschung ist maximal 10 Sekunden lang

- generiert mit verschiedenen KI-Modellen und Qualitätsstufen

- alle personengebunden – gezielt auf bestimmte Individuen trainiert

Die Wahl der 10-Sekunden-Clips war eine bewusste Design-Entscheidung. In der Praxis werden Deepfake-Angriffe oft mit kurzen, gezielten Clips durchgeführt – ein gefälschtes Geständnis, ein manipuliertes Statement, ein unangemessener Ausschnitt. Lange Videos sind aufwendiger zu generieren und bieten mehr Angriffsfläche für Artefakte. Die Trainingsstruktur spiegelt also die reale Bedrohungslage wider.

Die Forschung zeigt: Für die Erkennung mit rPPG-Methoden sind Videoabschnitte von 10 bis 30 Sekunden ideal, um stabile Vitalzeichen zu extrahieren. Kürzere Clips liefern zu wenig Messpunkte, längere bringen kaum zusätzlichen Erkenntnisgewinn.

Das Besondere: Kein anderes öffentlich bekanntes Projekt verfügt über eine vergleichbare Menge an Trainingsmaterial. Die meisten Forschungsdatensätze umfassen wenige Dutzend Stunden. Hier wurden 600 Stunden realer und synthetischer Inhalte gegeneinander ausgewertet.

Der Stand der Forschung: Warum einfache Herzschlagerkennung nicht mehr reicht

Bisher galt die Analyse der Lichtdurchlässigkeit der Haut (Remote-Photoplethysmographie, rPPG) als vielversprechende Methode zur Erkennung von Deepfakes. Die Logik war einfach: Deepfakes entstehen durch die Manipulation von Einzelbildern, wobei die feinen zeitlichen physiologischen Signale verloren gehen sollten.

Diese Annahme hat sich als falsch erwiesen.

Die aktuelle Forschung des Fraunhofer HHI zeigt: Hochwertige Deepfakes haben einen Herzschlag – und zwar den der Originalperson, deren Gesicht als Quelle diente. Die Herzfrequenz wird bei der Generierung „vererbt“, weil die Bewegung des Gesichts und die Hauttonvariationen zusammen übertragen werden.

Selbst fortschrittliche rPPG-basierte Detektoren haben Schwierigkeiten, diese Fälschungen zu erkennen. In Experimenten betrug die Abweichung zwischen geschätzter und tatsächlicher Pulsfrequenz lediglich zwei bis drei Schläge pro Minute – also gut innerhalb des realistischen Bereichs.

Das ist ein Weckruf für die Forschungsgemeinde. Die simple Frage „Hat das Video einen Puls?“ reicht nicht mehr.

Quellen:

- Fraunhofer HHI – Original-Pressemitteilung (2025)

- Frontiers in Imaging – wissenschaftliche Fachzeitschrift

Die Lösung: Räumliche und zeitliche Vitalmuster statt globaler Puls

Die Forscher sehen einen Ausweg: Der lokale Blutfluss im Gesicht ist die eigentliche Schwachstelle aktueller Deepfakes.

Während ein globaler Herzschlag simuliert werden kann, sind die räumlichen und zeitlichen Variationen des Blutflusses über verschiedene Gesichtsregionen hinweg extrem komplex. Ein echter Mensch zeigt unterschiedliche Perfusionsmuster in Stirn, Wangen und um die Augen herum – und diese Muster ändern sich über die Zeit auf eine Weise, die schwer zu modellieren ist.

Wie Prof. Peter Eisert vom Fraunhofer HHI erklärt: „Wenn das Herz schlägt, fließt Blut durch die Blutgefäße in das Gesicht. Es verteilt sich dann über den gesamten Gesichtsbereich, wo es zu minimalen Farbänderungen der Haut kommt, die wir in echten Aufnahmen aufzeichnen können.“ Die räumlich variierenden Verzögerungen dieser Bewegung sind ein entscheidendes Indiz, um echte Aufnahmen zu validieren.

Genau hier setzt unser System an. Es prüft drei grundlegende Kategorien von Vitalmustern, die zusammen eine räumlich-zeitliche Signatur ergeben:

1. Rhythmische Konsistenz

Ein menschlicher Körper arbeitet nicht chaotisch. Es gibt Grundrhythmen (kardiovaskulär, respiratorisch), die sich über Minuten kaum ändern. Deepfakes zeigen oft sprunghafte, inkonsistente „Rhythmen“ – oder gar keine. Die zeitliche Stabilität ist ein starkes Unterscheidungsmerkmal.

2. Räumliche Verteilung des Blutflusses

Der Blutfluss im Gesicht ist nicht gleichmäßig. Verschiedene Gesichtsregionen haben unterschiedliche Perfusionsmuster. Ein Deepfake kann einen globalen Puls simulieren, aber nicht die räumlich realistische Verteilung der Pulsamplitude über das gesamte Gesicht. Das ist die entscheidende Erkenntnis der aktuellen Forschung.

3. Frequenzstabilität und spektrale Signatur

Die feinen Schwankungen, die ein lebender Mensch zeigt, folgen bestimmten Frequenzbereichen (ca. 0,8–3,0 Hz für den Puls, 0,08–0,5 Hz für die Atmung). Ein Deepfake hat entweder keine oder falsch verteilte Frequenzen – oder die Frequenzen sind räumlich inkonsistent.

Keine dieser Prüfungen braucht einen medizinischen Kontext. Es reicht die einfache Frage: Ist da ein lebender Organismus mit räumlich-zeitlich konsistenten Vitalmustern – oder nur berechnete Pixel?

Wissenschaftliche Grundlagen:

- Fraunhofer HHI LinkedIn – Zusammenfassung der räumlichen Blutflussanalyse

- Biometric Update – Spatial blood flow analysis

Was Vitalzeichen wirklich sind (und was nicht)

Wichtig: Hier geht es nicht um medizinische Diagnostik. Es geht nicht darum, den exakten Puls oder Blutdruck zu messen. Es geht um eine binäre Frage:

Sind typische, menschliche Vitalrhythmen räumlich und zeitlich konsistent vorhanden – oder nicht?

Ein lebender Mensch zeigt immer bestimmte Muster:

- rhythmische Schwankungen, die mit dem Herz-Kreislauf-System zusammenhängen

- feine Modulationen, die durch die Atmung entstehen

- eine räumlich realistische Verteilung des Blutflusses über verschiedene Gesichtsregionen

- spektrale Konsistenz – also die Stabilität dieser Muster über die Zeit

Ein Deepfake kann die Optik perfekt imitieren. Aber es kann nicht leben. Es gibt keine echten physiologischen Prozesse hinter den Pixeln. Und selbst wenn ein globaler Puls übertragen wird – die räumliche Detailgenauigkeit des Blutflusses fehlt.

Das ist kein technisches Detail. Das ist eine fundamentale Grenze generativer KI.

Der unsichtbare Schutz: Ein Wort zu sensiblen Anwendungsfeldern

Es gibt Bereiche, in denen Deepfake-Erkennung besonders dringend gebraucht wird. Bereiche, über die man nicht gerne spricht. Aber die Realität ist unangenehm.

Die Verbreitung von nicht-eingewilligten, täuschend echten Inhalten mit Personen, die dort nie waren, ist ein massives Problem. Plattformen kämpfen täglich damit. Manuelle Prüfung skaliert nicht. Reine Bilderkennung versagt.

Die Vitalzeichen-Methode bietet hier einen automatisierbaren, zuverlässigen Filter. Keine Einzelfallprüfung mehr. Kein Rätselraten. Das System erkennt zuverlässig, ob die gezeigte Person tatsächlich vor der Kamera stand – oder ob alles nur berechnet ist.

Aktuelle kommerzielle Lösungen zeigen, dass automatisierte Deepfake-Erkennung und -Entfernung im großen Stil möglich ist. Loti AI erreicht eine Erfolgsrate von über 95% innerhalb von 17 Stunden. Die Plattform wird von Prominenten wie Keanu Reeves genutzt, um ihre digitale Identität zu schützen.

Auch Google hat kürzlich seine Bemühungen verstärkt, nicht-eingewilligte intime Inhalte aus der Suche zu entfernen. Ein neues Tool ermöglicht es Betroffenen, solche Inhalte mit einem einzigen Antrag aus den Suchergebnissen zu entfernen – inklusive proaktiver Filterung gegen Wiederhochladungen.

Der technologische Kampf gegen missbräuchliche Deepfakes hat eine neue Dimension erreicht. Das ist kein technisches Detail. Das ist Opferschutz. Und das sollte man nicht kleinreden.

Weiterführend:

- Loti AI – Partnerschaft mit Underscore Talent (2026)

- Loeb & Loeb – Interview mit Loti AI (Reel Talk Podcast)

- Google NCII Removal Tool (2026) – deutsch

- Google NCII Removal Tool – technische Erklärung

Grenzen des Ansatzes (die man kennen muss)

Kein System ist perfekt. Auch die Vitalzeichen-Erkennung hat ihre Schwächen:

Sehr kurze Videos (unter 5 Sekunden) liefern oft zu wenige Vitalmuster für eine stabile Entscheidung. Hier arbeitet das System mit reduzierter Zuverlässigkeit. Das Training mit 10-Sekunden-Clips bildet diese reale Einschränkung bewusst ab.

Extreme Bewegungen (hektisches Kopfschütteln, schnelle Kamerabewegungen) stören die räumliche Messung des Blutflusses. Ein stilles oder natürlich bewegtes Gesicht ist ideal.

Sehr schlechte Lichtverhältnisse (fast völlige Dunkelheit) machen die Vitalzeichen-Messung praktisch unmöglich, da die Hauttonvariationen nicht mehr erfasst werden können.

Starke Komprimierung (z.B. bei Videotelefonie oder sozialen Medien) kann feine Vitalzeichen zerstören. Das System ist robust, aber nicht unendlich.

Das sind keine Showstopper – aber man muss sie kennen, um das System richtig einzusetzen.

Fazit: Leben ist nicht simulierbar

Deepfakes werden immer besser. Aber sie werden niemals leben. Solange das stimmt, wird es einen zuverlässigen Weg geben, sie zu entlarven – insbesondere dann, wenn es um gezielte Fälschungen einer bestimmten Person geht.

Die 600 Stunden Trainingsmaterial – halb echt, halb synthetisch, letztere aufgebaut aus zehntausenden kurzen Clips – haben gezeigt: Die Vitalzeichen-Methode funktioniert in der Praxis. Nicht nur im Labor.

Wer personengebundene Deepfakes erkennen will, sollte nicht auf bessere Pixel schauen. Sondern auf das, was nicht gefälscht werden kann:

Das Leben selbst.

Und wer Plattformen betreibt, auf denen täuschend echte, nicht-eingewilligte Inhalte eine Rolle spielen, hat endlich ein Werkzeug, das automatisch, zuverlässig und ohne Einzelfallprüfung arbeitet.

Schreibe einen Kommentar